Navigation menu

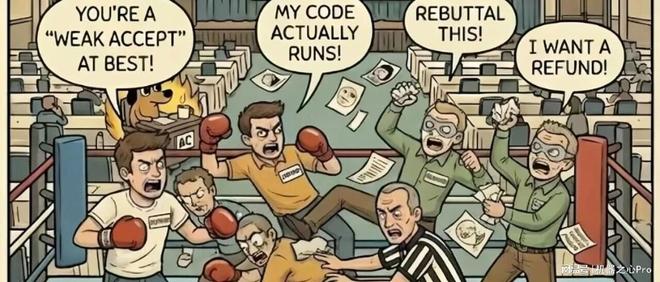

《机器之心》报道了真正开放的《机器之心》编辑部评论,“众神之父,给我视力!”昨晚不知道有多少人熬夜了。北京时间11月27日晚,国内人工智能界一片哗然。在经常用于评审学术论文的OpenReview平台上,一个前端bug导致了数据库泄露,使得原本的双盲评审变成了透明评审。此时泄露信息的方法很简单:只需在浏览器中输入特定的URL,替换掉你想看的论文ID和审稿号,就可以找到任意对应审稿人的身份。您可以了解谁评价了您的论文以及他给您打了多少分。因为没有操作门槛,消息传出后,大家立即切换到调查模式。毕竟,现在谁不和审稿人争吵呢?最终可以“为不公正付出代价”一时之间,引发了无数的惊喜、震惊、愤怒和悲痛。在微信群、小红书群里,到处都是受害者的故事,有的被强奸,有的被强奸。你永远猜不到是谁给你的文章打了低分。审稿人给低分的原因各不相同。有的是因为没有理解作者的初衷,有的是个人恩怨(比如兄弟姐妹在群里互相给低分),更恶心的是给低分有人利用这次泄密攻击了一篇给了1分的论文。审稿人居然在五个月后又提交了一篇论文,并且不想提及作者的投稿。很快社交媒体上就有消息称,一些涉嫌恶意低分的审稿人,在这篇论文被大家打开后,大幅提高了评分。lons表示,这次拆箱终于将AI峰会上论文分析中的严峻矛盾推向了一个新的高峰。该剧达到了新的高度,从黑暗森林到广播时代。永远不要假设您在互联网上是真正的匿名者。人们很快发现OpenReview中的这个漏洞是系统级的。只要在URL中多pin替换一个字符,还可以大开眼界看其他ICLR论文,以及neurips、ICML、ACL等顶级AI会议。众所周知,由于AI领域的蓬勃发展和投稿量的快速增加,各种会议都面临审稿人不足的问题,人们常常抱怨审稿人水平下降。在 ICLR 2026 上,Pangram Labs 做了数据分析,认为大约 21% 的 ICLR 同行评审完全由人工智能生成,并且一半以上的评审都有使用人工智能的痕迹。当然,另一方面另一方面,发现 199 篇论文完全由 AI 生成,其中 9% 的论文中超过 50% 的文本是由 AI 生成的。作为人工智能领域三大顶级会议之一,ICLR近年来持续受到学术界和工业界的关注。 2026年会议将于明年4月在巴西里约热内卢举行。本次会议共收到19,490篇研究论文提交,其中75,800条同行评审意见。周五午夜左右,该 bug 很快得到修复,ICLR 最终发布了官方声明。 ICLR表示,任何使用、曝光或分享泄露信息的人都将被ICLR断绝关系并被禁止多年,会议组织者计划未来采取进一步行动。随后,OpenReview也发布了官方公告。但这并不妨碍一些人吃瓜。显然有人爬遍了整个列表并开始分析数据。有些人列出了 sco 异常低的审稿人水库根据 ICLR 2026 前 10,000 份提交的评估结果,结合审稿人所在国家(主要语言),为个人提供平均评分趋势。看来中国人普遍比较慷慨,而韩国人则相当严格。照这样下去,也许用不了多久我们就能查出写下“亚当是谁?”的人是谁。看看今年八月的 Neurips。学术界和工业界的大人物也纷纷关注这一现象并发表评论。加州理工学院计算机与数学科学教授、ICLR 理事会成员、ICLR 2025 主席岳一松表示:“我们今天要开会,我很兴奋。”总体而言,此次 ICLR 泄密严重损害了学术公平。审稿人匿名性的丧失抑制了批判性研究的产出,并为作者提供了进一步反击的可能性,从而破坏了原有的平衡。这会影响接受申请的可信度人。但另一方面,由于原本完全匿名的审稿人有时会出现恶意的、不负责任的评论,这次泄密引发的瞬间热度也值得思考。不知道此后匿名评审制度会不会改变?

特别声明:以上内容(如有则包括照片或视频)由自媒体平台“网易号”用户上传发布。本平台仅提供信息存储服务。

注:以上内容(包括图片和视频,如有)由网易HAO用户上传并发布,网易HAO是一个社交媒体平台,仅提供信息imba服务。

《机器之心》报道了真正开放的《机器之心》编辑部评论,“众神之父,给我视力!”昨晚不知道有多少人熬夜了。北京时间11月27日晚,国内人工智能界一片哗然。在经常用于评审学术论文的OpenReview平台上,一个前端bug导致了数据库泄露,使得原本的双盲评审变成了透明评审。此时泄露信息的方法很简单:只需在浏览器中输入特定的URL,替换掉你想看的论文ID和审稿号,就可以找到任意对应审稿人的身份。您可以了解谁评价了您的论文以及他给您打了多少分。因为没有操作门槛,消息传出后,大家立即切换到调查模式。毕竟,现在谁不和审稿人争吵呢?最终可以“为不公正付出代价”一时之间,引发了无数的惊喜、震惊、愤怒和悲痛。在微信群、小红书群里,到处都是受害者的故事,有的被强奸,有的被强奸。你永远猜不到是谁给你的文章打了低分。审稿人给低分的原因各不相同。有的是因为没有理解作者的初衷,有的是个人恩怨(比如兄弟姐妹在群里互相给低分),更恶心的是给低分有人利用这次泄密攻击了一篇给了1分的论文。审稿人居然在五个月后又提交了一篇论文,并且不想提及作者的投稿。很快社交媒体上就有消息称,一些涉嫌恶意低分的审稿人,在这篇论文被大家打开后,大幅提高了评分。lons表示,这次拆箱终于将AI峰会上论文分析中的严峻矛盾推向了一个新的高峰。该剧达到了新的高度,从黑暗森林到广播时代。永远不要假设您在互联网上是真正的匿名者。人们很快发现OpenReview中的这个漏洞是系统级的。只要在URL中多pin替换一个字符,还可以大开眼界看其他ICLR论文,以及neurips、ICML、ACL等顶级AI会议。众所周知,由于AI领域的蓬勃发展和投稿量的快速增加,各种会议都面临审稿人不足的问题,人们常常抱怨审稿人水平下降。在 ICLR 2026 上,Pangram Labs 做了数据分析,认为大约 21% 的 ICLR 同行评审完全由人工智能生成,并且一半以上的评审都有使用人工智能的痕迹。当然,另一方面另一方面,发现 199 篇论文完全由 AI 生成,其中 9% 的论文中超过 50% 的文本是由 AI 生成的。作为人工智能领域三大顶级会议之一,ICLR近年来持续受到学术界和工业界的关注。 2026年会议将于明年4月在巴西里约热内卢举行。本次会议共收到19,490篇研究论文提交,其中75,800条同行评审意见。周五午夜左右,该 bug 很快得到修复,ICLR 最终发布了官方声明。 ICLR表示,任何使用、曝光或分享泄露信息的人都将被ICLR断绝关系并被禁止多年,会议组织者计划未来采取进一步行动。随后,OpenReview也发布了官方公告。但这并不妨碍一些人吃瓜。显然有人爬遍了整个列表并开始分析数据。有些人列出了 sco 异常低的审稿人水库根据 ICLR 2026 前 10,000 份提交的评估结果,结合审稿人所在国家(主要语言),为个人提供平均评分趋势。看来中国人普遍比较慷慨,而韩国人则相当严格。照这样下去,也许用不了多久我们就能查出写下“亚当是谁?”的人是谁。看看今年八月的 Neurips。学术界和工业界的大人物也纷纷关注这一现象并发表评论。加州理工学院计算机与数学科学教授、ICLR 理事会成员、ICLR 2025 主席岳一松表示:“我们今天要开会,我很兴奋。”总体而言,此次 ICLR 泄密严重损害了学术公平。审稿人匿名性的丧失抑制了批判性研究的产出,并为作者提供了进一步反击的可能性,从而破坏了原有的平衡。这会影响接受申请的可信度人。但另一方面,由于原本完全匿名的审稿人有时会出现恶意的、不负责任的评论,这次泄密引发的瞬间热度也值得思考。不知道此后匿名评审制度会不会改变?

特别声明:以上内容(如有则包括照片或视频)由自媒体平台“网易号”用户上传发布。本平台仅提供信息存储服务。

注:以上内容(包括图片和视频,如有)由网易HAO用户上传并发布,网易HAO是一个社交媒体平台,仅提供信息imba服务。